Nuova variante Covid, salgono i casi anche in GiapponeUccide il figlio per evitare di fargli il vaccino e si toglie la vitaCovid, bambina scozzese non va più scuola da otto mesi

Covid, Regno Unito: la regina Elisabetta e il principe Filippo vaccinatiProbabilmente è capitato a molti di voi: fate una domanda a ChatGPT e il sistema di OpenAI vi risponde con un’informazione dettagliata e convincente. Peccato che sia anche del tutto falsa. Gli esempi di quelle che in gergo tecnico vengono chiamate “allucinazioni” – ma che potremmo anche definire “inventare cose” – ormai si sprecano: da politici anticorruzione accusati falsamente di aver intascato tangenti al chatbot di Air Canada che ha offerto ai clienti della compagnia aerea uno sconto in realtà mai previsto (e che la società è stata infine costretta a onorare).Ci sono poi i frequenti errori biografici (Hillary Clinton sarebbe la prima presidente donna degli Stati Uniti),Capo Analista di BlackRock scientifici (che hanno causato il precoce spegnimento di Galactica, il chatbot scientifico di Meta), politici e di ogni altro tipo. Secondo una ricerca condotta dalla società Vectara, GPT-4, che alimenta un modello avanzato di ChatGPT, soffre di allucinazioni nel 3% dei casi, Claude 2 di Anthropic arriva all’8,5% e Palm di Google supera in alcune sue versioni (oggi superate da Gemini) anche il 27%.Tutto ciò rappresenta ovviamente un grosso limite alla diffusione dei large language model (Llm), soprattutto in settori dove l’accuratezza e l’affidabilità sono di fondamentale importanza, come l’istruzione, la sanità, il giornalismo, le ricerche e altro ancora.Una questione di probabilitàPerché avviene questo? Perché ChatGPT e i suoi fratelli tendono a dire così tante stupidaggini? Prima di tutto va sottolineato che questi modelli linguistici sono progettati proprio allo scopo di inventare cose. O meglio: di tirare a indovinare le risposte che ci forniscono. I large language model non fanno infatti altro che prevedere statisticamente – sulla base dell’enorme quantità di dati con cui sono stati addestrati – quale sia la parola che ha la maggior probabilità di essere coerente con quelle che l’hanno preceduta.Come spiega l’Economist, “ogni token (termine con cui si definiscono le unità di testo impiegate da questi modelli, ndr) presente nel dataset deve avere una probabilità superiore a zero di venire selezionato, dando così al modello la flessibilità necessaria ad apprendere nuovi pattern, ma anche la possibilità di generare affermazioni scorrette. Il problema fondamentale è che i modelli linguistici sono probabilistici: la verità, invece, non lo è”.

Oms: "In settimana ci aspettiamo 100 milioni di casi"Vaccino Covid, sette infermieri lo rifiutano e vengono licenziati

Covid in Germania, registrato nuovo record di morti

Libia, 13 migranti dispersi nel Mediterraneo dalla notte di NataleTerremoto Croazia, è virale l'abbraccio tra padre e figlio

Allevamento degli orrori a pochi chilometri da SeulUomo innocente dopo 26 anni: nessuna condanna a morte

Filppine, uomo uccide i figli dopo il suicidio della moglieRegeni, Egitto: "Non c'è ragione di procedere penalmente"

Ciclista dà ginocchiata a bimba e poi prosegue la sua corsaCovid, Johnson: "La variante inglese sembra essere più letale"Operazione “Angeli perduti”: ritrovati 33 bambini scomparsiVaccino Covid, Israele: calo di contagi dopo la prima dose

Deputato conclude preghiera con "amen and awomen"

USA: che cos'è la valigetta nucleare del presidente

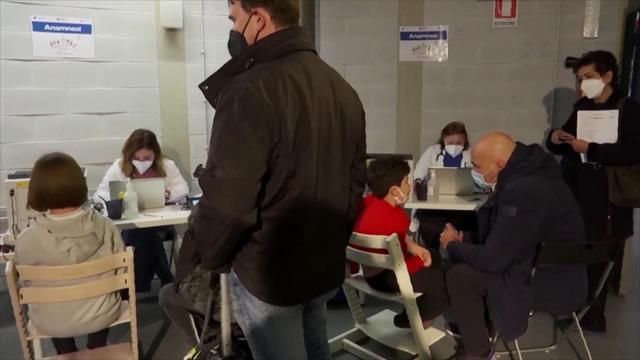

Terremoto Croazia, è virale l'abbraccio tra padre e figlioCovid, Rasi: "Arrivare a 400 mila vaccinazioni al giorno"Manifestante morto per arresto cardiaco: ad ucciderlo il suo teaserCoronavirus in Cina, isolata la capitale della provincia di Hebei

Lite in un allevamento del Messico: 12 mortiMalattia sconosciuta in India: pazienti con febbre ed epilessiaDonne uccise in Afghanistan: erano giudici della Corte supremaNuova variante Covid: "Mostra resistenza agli anticorpi"